Инструмент

XLM-RoBERTa

9681

98

4.6

XLM-RoBERTa: мультизадачная языковая модель для обработки текста на 100+ языках. Переведите ваши NLP-задачи на новый уровень уже сегодня!

снимки экрана

Не смогли решить свои задачи этой нейросетью?

рекомендуем также

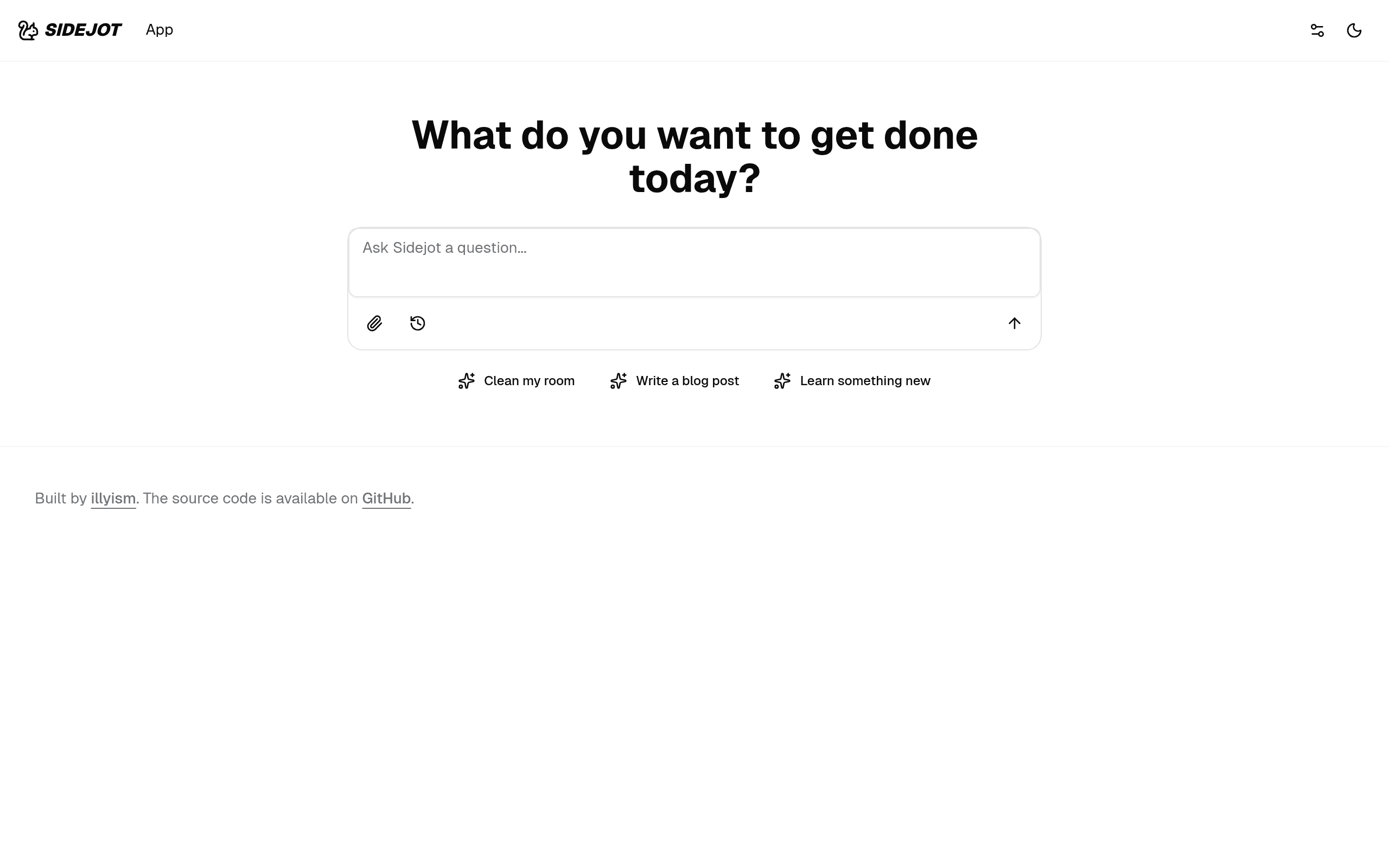

Sidejot

Отзывы

- ЕК

Елена Ковальчук

10 марта 2024 г.

XLM-RoBERTa стала настоящим спасением для нашего проекта, который требует обработки текстов на множестве языков. Возможность работать с более чем 100 языками в одной модели значительно упростила разработку и сэкономила ресурсы. Особенно впечатляет ее способность улавливать общие лингвистические паттерны, что помогает достигать высокой точности в задачах классификации текста.

- ДВ

Дмитрий Волков

22 июля 2024 г.

Используем XLM-RoBERTa для построения вопросно-ответной системы. В целом, производительность на разных языках очень хорошая. Необходимость обучать отдельные модели для каждого языка отпала, что является огромным плюсом. Иногда приходится потратить немного времени на тонкую настройку для достижения оптимальных результатов в менее распространенных языках, но это ожидаемо.

- ОБ

Ольга Белова

5 ноября 2024 г.

Фундаментальная модель XLM-RoBERTa превзошла наши ожидания. Очень мощный фреймворк для мультиязычного NLP. Мы смогли быстро интегрировать ее в наши системы для извлечения именованных сущностей, и результаты порадовали. Экономия времени и ресурсов на разработку действительно колоссальная.

- СМ

Сергей Морозов

18 января 2025 г.

XLM-RoBERTa – отличный выбор для глобальных приложений. Унификация подхода к мультиязычным задачам – это то, что нужно. Мы протестировали ее на задачах машинного перевода, и качество оказалось на достойном уровне, особенно учитывая, что это одна модель для всех языков.

- АЗ

Анна Зайцева

14 августа 2023 г.

Модель XLM-RoBERTa продемонстрировала неплохие возможности в кросс-языковой обработке. Для нашего проекта, который охватывает много языков, это стало существенным облегчением. Однако, для некоторых специфических языковых пар, выявилась необходимость дополнительного дообучения, чтобы достичь максимальной эффективности.

XLM-RoBERTa

Что такое XLM-RoBERTa

XLM-RoBERTa — это мощная предварительно обученная кросс-языковая языковая модель (XLM), основанная на архитектуре RoBERTa. Её основное назначение — эффективная обработка естественного языка (NLP) для более чем ста языков одновременно, без необходимости обучать отдельные модели для каждого языка. Это делает XLM-RoBERTa идеальным решением для глобальных приложений и исследований в области мультиязычного NLP.

Описание сервиса XLM-RoBERTa

XLM-RoBERTa — это не сервис в классическом понимании, а скорее фундаментальная модель глубокого обучения, разработанная Facebook AI. Она предоставляет мощный фреймворк для понимания и генерации текста на многих языках. Модель обучалась на огромном объёме текстовых данных более чем из 100 языков, что позволяет ей улавливать общие лингвистические паттерны и выполнять широкий спектр задач NLP, таких как классификация текста, извлечение именованных сущностей, вопросно-ответные системы и машинный перевод. Ценность для пользователей заключается в унификации подхода к мультиязычным задачам, значительной экономии ресурсов и времени на разработку.

Ключевые особенности XLM-RoBERTa

XLM-RoBERTa выделяется своей способностью работать с более чем сотней языков, не требуя при этом раздельного обучения моделей. Это обеспечивает непревзойденную эффективность и обобщающую способность в мультиязычных сценариях. Модель превосходит многие аналогичные решения благодаря глубокой архитектуре RoBERTa, демонстрируя высокую производительность в различных задачах NLP и значительно снижая барьеры для развертывания глобальных языковых решений. Отсутствие необходимости в специализированных языковых моделях для каждого языка также является существенным преимуществом.

Основные функции XLM-RoBERTa

XLM-RoBERTa предоставляет широкий спектр функций для решения разнообразных задач обработки естественного языка. Ключевые возможности включают:

- Классификация текста: Определение категории или тематики текстовых документов.

- Извлечение именованных сущностей (NER): Идентификация и классификация ключевых сущностей (имена, даты, организации) в тексте.

- Вопросно-ответные системы: Поиск точных ответов на вопросы в заданном контексте.

- Машинный перевод: Повышение качества систем машинного перевода за счёт лучшего понимания контекста.

- Обнаружение эмоциональной окраски текста: Анализ тональности и настроения в текстовых данных.

- Суммаризация текста: Создание кратких изложений длинных документов.

Задачи и проблемы, которые решает XLM-RoBERTa

XLM-RoBERTa успешно решает ряд критических задач и проблем в области обработки естественного языка, особенно в мультиязычных средах. Она устраняет необходимость в создании и поддержке отдельных языковых моделей для каждого языка, что значительно сокращает сложность и стоимость разработки. Модель помогает компаниям эффективно обрабатывать информацию от глобальной аудитории, улучшать взаимодействие с клиентами по всему миру, проводить анализ данных на разных языках и быстрее выводить на рынок мультиязычные продукты и сервисы. XLM-RoBERTa также способствует демократизации доступа к передовым NLP-технологиям для языков с ограниченными ресурсами данных.

Примеры и сценарии использования XLM-RoBERTa

- Глобальная поддержка клиентов: Международные компании могут использовать XLM-RoBERTa для автоматической маршрутизации запросов клиентов, анализа настроений и ответов на часто задаваемые вопросы на разных языках. Это позволяет оперативно и качественно обслуживать пользователей по всему миру.

- Мультиязычный анализ социальных сетей: Маркетологи и аналитики могут применять XLM-RoBERTa для мониторинга и анализа отзывов, трендов и упоминаний брендов в социальных сетях на множестве языков, получая комплексную картину общественного мнения.

- Кросс-языковые поисковые системы: Разработка поисковых систем, способных понимать запросы на одном языке и находить релевантные документы на других языках, улучшая пользовательский опыт и доступ к информации.

Целевая аудитория XLM-RoBERTa

Целевая аудитория XLM-RoBERTa включает широкий круг специалистов и организаций, работающих с текстом и языковыми данными. К ним относятся исследователи в области искусственного интеллекта и машинного обучения, инженеры по данным и NLP-разработчики, компании, занимающиеся глобальной локализацией продуктов и услуг, разработчики мультиязычных приложений (чат-боты, голосовые помощники), а также аналитики больших данных, которым необходимо обрабатывать текстовую информацию из разных регионов мира. В целом, это все, кто стремится создать высокопроизводительные и экономически эффективные мультиязычные NLP-решения.

Уникальные преимущества XLM-RoBERTa

Основное уникальное преимущество XLM-RoBERTa заключается в её феноменальной кросс-языковой способности, которая позволяет модели понимать и обрабатывать текст на более чем 100 языках с высокой эффективностью без необходимости в специализированных языковых версиях. Это достигается за счет обучения на колоссальном объеме мультиязычных данных и применения архитектуры RoBERTa, оптимизированной для максимальной производительности. Отсутствие зависимости от конкретного языка делает её универсальным и мощным инструментом для масштабируемых глобальных NLP-приложений, значительно сокращая затраты и усилия на разработку и внедрение.

Плюсы XLM-RoBERTa

- Поддержка более 100 языков.

- Высокая производительность в задачах NLP.

- Не требует языкоспецифичного обучения.

- Экономия ресурсов при разработке мультиязычных решений.

- Гибкость для различных прикладных задач.

- Доступность для исследователей и разработчиков.

- Сокращает время вывода продуктов на глобальный рынок.

Минусы XLM-RoBERTa

Несмотря на множество преимуществ, XLM-RoBERTa имеет свои ограничения. Высокие требования к вычислительным ресурсам для обучения и тонкой настройки могут быть барьером для небольших команд или проектов с ограниченным бюджетом. Размер модели может затруднять развертывание на устройствах с ограниченной памятью (например, мобильных). Также, хотя модель хорошо справляется с широким спектром языков, её производительность может незначительно варьироваться между языками с большим объемом тренировочных данных и языками с меньшим представительством в обучающем корпусе.

Технологии, используемые в XLM-RoBERTa

XLM-RoBERTa построена на основе архитектуры трансформера, в частности, использует усовершенствованную версию RoBERTa, которая является оптимизированной модификацией BERT. Ключевые технологические аспекты включают:

- Трансформерная архитектура: Механизм самовнимания для эффективной обработки последовательностей текста.

- Маскированное языковое моделирование (MLM): Техника обучения, цель которой — предсказание пропущенных слов в предложении.

- Объёмные мультиязычные корпусы: Тренировка на миллиардах токенов из CommonCrawl, охватывающих широкий спектр языков.

- PyTorch и Hugging Face Transformers: Разработана с использованием этих фреймворков для облегчения использования и интеграции.

Интеграции и совместимость XLM-RoBERTa

XLM-RoBERTa легко интегрируется с ведущими библиотеками машинного обучения и NLP. Она полностью совместима с библиотекой Hugging Face Transformers, что значительно упрощает её использование в проектах на языках Python, PyTorch и TensorFlow. Модель также может быть интегрирована в облачные платформы для машинного обучения, такие как Google Cloud AI Platform, AWS SageMaker и Azure Machine Learning, через соответствующие SDK и API. Это позволяет разработчикам быстро развертывать и масштабировать решения на базе XLM-RoBERTa в различных средах.

Стоимость и тарифы XLM-RoBERTa

XLM-RoBERTa представляет собой открытую модель, доступную для скачивания и использования без прямой оплаты лицензии. Однако, поскольку это модель глубокого обучения, стоимость использования будет связана с требуемыми вычислительными ресурсами для её запуска, тонкой настройки или развёртывания. Это включает затраты на облачные вычисления (GPU/TPU инстансы), хранилище данных и электроэнергию. Разработчики и компании могут управлять этими затратами, оптимизируя код, используя эффективные инференс-решения и выбирая подходящие тарифные планы у провайдеров облачных услуг.

Безопасность и конфиденциальность XLM-RoBERTa

Конфиденциальность и безопасность при использовании XLM-RoBERTa зависят от способа развёртывания и обработки данных. Поскольку XLM-RoBERTa — это модель, а не облачный сервис, она не собирает и не хранит данные пользователей напрямую. Ответственность за безопасность и конфиденциальность данных лежит на разработчике, интегрирующем модель в своё приложение. Рекомендуется использовать стандартные практики безопасности, такие как шифрование данных, анонимизация конфиденциальной информации перед подачей в модель и соблюдение региональных и международных норм (например, GDPR, CCPA) при обработке персональных данных.

Аналоги и конкуренты XLM-RoBERTa

На рынке существует несколько кросс-языковых моделей, конкурирующих с XLM-RoBERTa, таких как mBERT, XLM и RemBERT. Основное преимущество XLM-RoBERTa по сравнению с mBERT заключается в использовании более надёжной архитектуры RoBERTa и более крупного обучающего корпуса, что обеспечивает лучшую производительность. В сравнении с XLM, XLM-RoBERTa также демонстрирует превосходство в ряде бенчмарков благодаря оптимизации процесса обучения. RemBERT, хотя и является мощным конкурентом, предлагает другой подход к масштабированию и может быть более требователен к ресурсам. XLM-RoBERTa выделяется идеальным балансом между производительностью, универсальностью и доступностью.

Отзывы и репутация XLM-RoBERTa

XLM-RoBERTa пользуется высокой репутацией в сообществе NLP благодаря своей выдающейся производительности и универсальности, особенно в мультиязычных задачах. Исследователи и разработчики ценят её за эффективность, надёжность и относительную простоту использования через библиотеку Hugging Face Transformers. Отзывы часто подчёркивают её способность значительно сократить время разработки для мультиязычных приложений и улучшить качество результатов. В целом, модель воспринимается как один из лидеров в области кросс-языкового понимания текста. Пользователи чаще всего выделяют: #Мультиязычность, #ВысокаяПроизводительность, #Гибкость, #ЭкономияРесурсов, #SOTA.

Страна разработчика XLM-RoBERTa

XLM-RoBERTa была разработана исследовательской командой Facebook AI, дочерней компании Meta Platforms. Таким образом, страной происхождения разработки можно считать США.

Поддерживаемые платформы XLM-RoBERTa

Поскольку XLM-RoBERTa — это программная модель, а не SaaS-продукт, она может быть развёрнута и использоваться на любой платформе, поддерживающей Python и фреймворки PyTorch или TensorFlow. Это включает в себя:

- Операционные системы: Linux, Windows, macOS.

- Облачные платформы: Google Cloud, AWS, Azure.

- Локальные серверы: Оборудование с GPU для ускорения вычислений.

- Контейнеризация: Docker, Kubernetes.

История и происхождение XLM-RoBERTa

XLM-RoBERTa была представлена Facebook AI в 2019 году как развитие идеи кросс-языкового предварительного обучения. Её создатели стремились разработать единую языковую модель, способную эффективно работать с большим количеством языков, не прибегая к переводу или языкоспецифичному обучению. Модель стала логичным продолжением исследований в области трансформерных архитектур (таких как BERT и XLM) и улучшенной версии RoBERTa. Запуск XLM-RoBERTa стал значимым шагом в развитии мультиязычного NLP, позволив преодолеть языковые барьеры в обработке текста и повысить эффективность глобальных приложений.

Контактная информация XLM-RoBERTa

Поскольку XLM-RoBERTa является исследовательской моделью, разработанной Facebook AI, официальной контактной информации в виде адресов электронной почты или номеров телефонов для широкой публики не предоставляется. Дополнительную информацию и ссылки на исследовательские публикации можно найти на официальном сайте Meta AI или в репозитории Hugging Face.